解析不同种类的StableDiffusion模型Models,再也不用担心该用什么了

Stable Diffusion是一个基于Latent Diffusion Models(潜在扩散模型,LDMs)的文图生成(text-to-image)模型。具体来说,Stable Diffusion在 LAION-5B 的一个子集上训练了一个Latent Diffusion Models,该模型

Stable Diffusion 准确绘制人物动作及手脚细节(需ControlNet扩展)

目前AI绘图还是比较像开盲盒,虽然能根据语义提供惊艳的图片,但是与设计师所构思的目标还是有一定距离。那像我们这种没有绘画功底的程序员想要制作出心中的人物(尤其手脚)姿态,该怎样减少随机开盒的次数呢?本文提供几种精确控制人物动作的方法,从易到繁,从粗到细,其中方法四是。注意:正式使用前请先确认你的St

本地生成动漫风格 AI 绘画 图像|Stable Diffusion WebUI 的安装和局域网部署教程

先放一张WebUI的图片生成效果图对比,以给大家学习的动力 :)怎么样,有没有小小的心动?这里再补充一下,是可以生成的图片的。

【Stable Diffusion】windows 1050显卡,17年笔记本还能再战

Stable Diffusion 笔记本1050显卡本地环境

最新版本 Stable Diffusion 开源 AI 绘画工具之使用篇

学好使用方式让你的绘画技术突飞猛进

【翻译】图解Stable Diffusion

扩散”指的是下图中粉色这一块组件“图像信息生成器”中发生的处理过程。该组件获取能表示输入文本信息的token嵌入和一个随机初始化的图像信息张量(aka 潜变量),然后用它们生成一个信息张量,把这个信息张量交给图像解码器,去生成最终的图像。这个过程是一步一步进行的,逐步添加相关信息。想更直观的了解这个

如何在亚马逊 SageMaker 进行 Stable Diffusion 模型在线服务部署

最近以AIGC带来巨大生产力提升的时尚宠儿不断进化升级,争相亮相。我们迎来ChatGPT 系列技术带给我们一波又一波的AI盛宴,而在计算机视觉领域,AI 绘画近两年正在逐渐走向图像生成舞台的中央。最近受邀参加了亚马逊云科技 『云上探索实验室』实践云上技术的系列活动,通过Amazon SageMake

超越语言界限,ChatGPT进化之路——Visual ChatGPT

当前版本的ChatGPT仅限于基于文本的答案,并使用GPT-3.5。然而,在下一次迭代中,这个限制将被消除。据称,GPT-4将是一项重大更新,具备多模态模型能力,这将显着提升其能力,支持AI生成的视频和其他内容。此外,就在昨天微软官方在Github开源了一个重量级的ChatGPT AI交互应用Vis

Stable Diffusion安装教程、model导入教程以及精品promt指令

Stable Diffusion安装教程、model导入教程以及精品promt指令

CentOs7 + Stable Diffusion + Novel AI实现AI绘画

把改名后的三个文件放到/stable-diffusion-webui/models/Stable-diffusion目录下,重启Stable Diffusion后左上角选择nai模型。整个内容很大,有52G,只需下载stableckpt目录下的animefull-final-pruned文件夹以及a

Stable Diffusion 视频和图片帧互换以及AI动画帧生成

Stable Diffusion 只做AI动画是基于把原有视频按照帧进行提取之后对每一帧的图像进行标准化流程操作,中间可以掺杂Controlnet对人物进行控制,使用关键词对画面进行控制,但是很多小伙伴不太会掌握一些编辑视频软件或者python的操作导致视频转帧,帧转视频会出现一些问题。这里分享2套

Stable Diffusion教学 使用Lora制作AI网红 【AI绘画真人教程】

Stable Diffusion教学 使用Lora制作AI网红【AI绘画】一键启动/修复/更新/模型下载管理全支持!

【Mac M1】安装stable diffusion webui教程及问题集锦

【Mac M1】安装stable diffusion webui教程及问题集锦,stable diffusion汉化,ControlNet 插件安装等

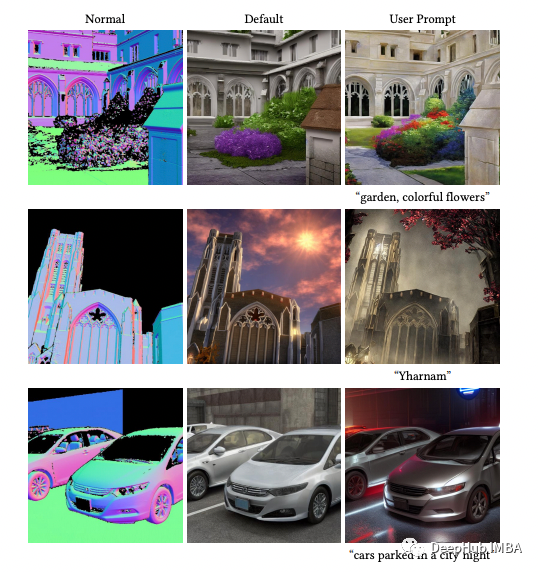

常用的ControlNet以及如何在Stable Diffusion WebUI中使用

ControlNet是斯坦福大学研究人员开发的Stable Diffusion的扩展,使创作者能够轻松地控制AI图像和视频中的对象

Stable Diffusion - API和微服务开发

基于机器学习的数据生成器在去年发生了如此多的创新,你可以将 2022 年称为“生成 AI 年”。我们有 DALL-E 2,这是来自 OpenAI 的文本到图像生成模型,它生成了宇航员骑马和狗穿着人衣服的惊人逼真的图像。GitHub Copilot 是一款功能强大的代码完成工具,可以自动完成语句、编写

AI绘画黑科技Stable Diffusion WebUI在线部署使用教程

AI绘画黑科技Stable Diffusion,能够根据文字描述生成精美图像,开源且在消费级GPU上就能运行。Stable Diffusion WebUI是Stable Diffusion的Web版,提供了便捷的WebUI交互界面,部署使用方便,支持中文汉化插件,而且通过Stable Diffusi

Windows使用Stable Diffusion时遇到的各种问题和知识点整理(更新中...)

Stable Diffusion安装完成后,在使用过程中会出现卡死、文件不存在等问题,在本文中将把遇到的问题陆续记录下来,有兴趣的朋友可以参考。

Stable Diffusion安装与常见错误(+Lora使用)2023年最新安装教程

帮你快速搭建Stable Diffusion(2023年版本)

Stable Diffusion 原理介绍与源码分析(一)

本文以 “文本生成图像(text to image)” 为主线,考察 Stable Diffusion 的运行流程以及各个重要的组成模块,在介绍时采用 “总-分” 的形式,先概括整体框架,再分析各个组件(如 DDPM、DDIM 等),另外针对代码中的部分非主流逻辑,比如 `predict_cids`

stable-diffusion-webui教程(AI绘画真人教程)

stable-diffusion-webui教程(AI绘画真人教程)